NVIDIA 21日在微軟開發者大會上宣布推出適用於 Windows 的全新AI效能最佳化及整合,可幫助 NVIDIA GeForce RTX AI PC 及 NVIDIA RTX 工作站呈現最佳效能。

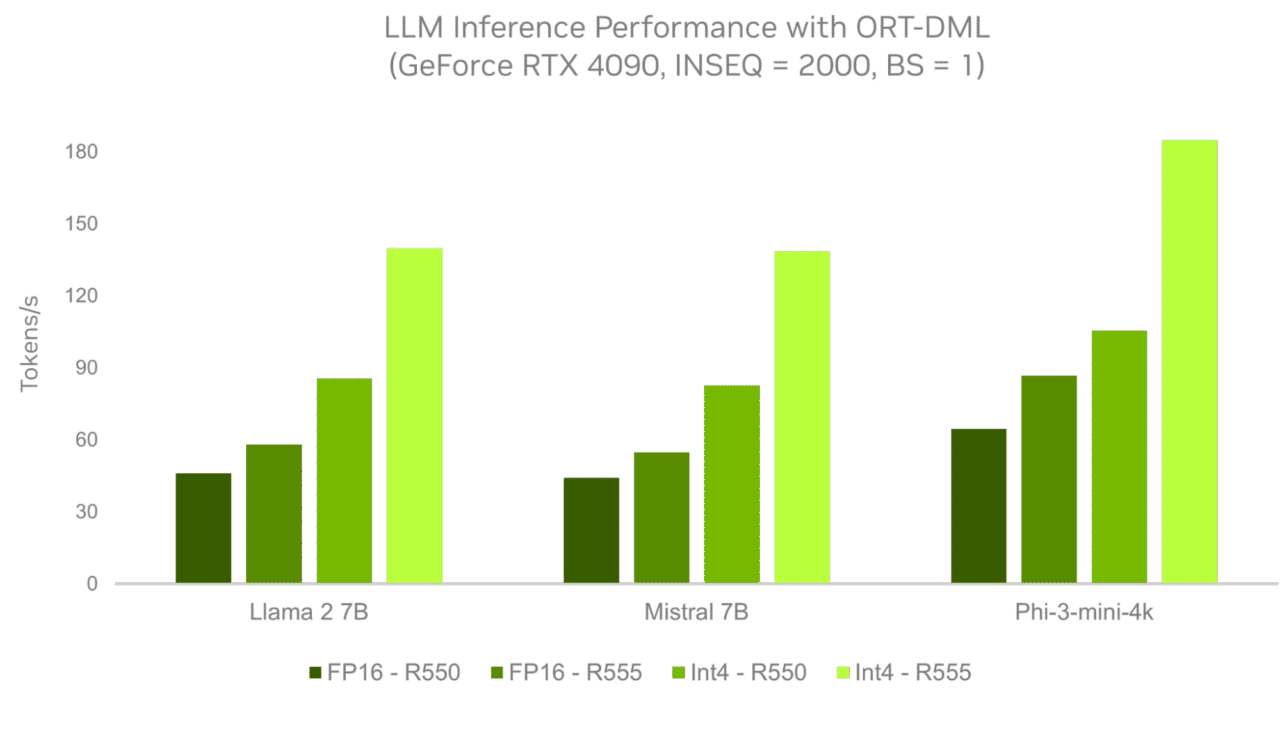

大型語言模型(LLM)的支援帶來了生成式AI領域裡最亮眼的全新使用案例支援,現在使用全新 NVIDIA R555 Game Ready 驅動程式,在運行 ONNX Runtime(ORT)及 DirectML 時,運行速度最高可提高三倍。ORT 與 DirectML 是用於 Windows PC 上本機端運行AI模型的高效能工具。

WebNN 是一種供網路應用程式開發者部署AI模型的應用程式介面,現在可以透過 DirectML 使用 RTX 加快其執行速度,讓網路應用程式能夠納入高速的AI功能。PyTorch 將支援 DirectML 後端執行,使Windows 開發者能夠在 Windows 上以原生形式訓練和推論複雜的AI模型。NVIDIA 與微軟正在合作提升 RTX GPU 的執行效能。

上述技術創新建立在 NVIDIA 領先全球的AI平台上,可加快執行全球一億多台 RTX AI PC 和工作站上的 500 多個應用程式和遊戲。

RTX AI PC為遊戲玩家、創作者和開發者推出更強大的AI

NVIDIA 於 2018 年推出首款具有專用AI加速功能的 PC GPU,搭載 Tensor 核心的 GeForce RTX 20 系列,以及首個在 Windows 上運行廣泛採用的AI模型 NVIDIA DLSS。NVIDIA 最新的 GPU 可提供高達每秒 1,300 兆次運算的專用AI效能。

在未來數月裡,搭載全新高能效系統單晶片及 RTX GPU 的 Copilot+ PC 將陸續問世,為遊戲玩家、創作者、愛好者及開發者提供更出色的效能,以處理本機端AI工作負載的吃重要求,同時提供微軟全新的 Copilot+ 功能。

針對使用 RTX AI PC 的遊戲玩家,NVIDIA DLSS 可將畫格率提高四倍,而 NVIDIA ACE 則可藉由AI技術創造出的對話、動畫和語音,呈現栩栩如生的遊戲角色。

對於內容創作者,RTX 可在 Adobe Premiere、Blackmagic Design DaVinci Resolve 和 Blender 等應用程式中支援AI輔助製作工作流程,自動執行繁瑣任務與簡化工作流程。從 3D 降噪和加速渲染,再到文字轉影像和影片的生成,這些工具讓藝術家們能夠將他們腦海裡的想法化為現實。

針對遊戲模改玩家,建立在 NVIDIA Omniverse 平台上的 NVIDIA RTX Remix 能夠提供AI加速工具,以創造RTX 重製版的經典 PC 遊戲。它讓擷取遊戲資產、使用生成式AI工具增強材質,以及融合完整的光線追蹤等變得更加簡單。

而對於直播主們,NVIDIA Broadcast 應用程式可提供高品質的AI去背及降噪功能,而 NVIDIA RTX Video可提供AI升頻及自動高動態範圍功能,以提高串流媒體影片的品質。

在 RTX GPU 的支援下,LLM 可以更快地執行AI助理及輔助功能,並且能夠同時處理多個請求,以此來可提高工作效率。

而RTX AI PC 讓開發者使用包括NVIDIA AI Workbench、NVIDIA cuDNN 和 CUDA on Windows Subsystem for Linux的 NVIDIA AI 開發者工具,由此能夠直接在裝置上建立及微調AI模型。開發者還可以使用 RTX 加速的AI框架和軟體開發套件,比如 NVIDIA TensorRT、NVIDIA Maxine 及 RTX Video。

AI功能和出色效能的組合,為遊戲玩家、創作者和開發者創造出更美好的使用體驗。

為網路應用程式開發者提供更快的 LLM 和新功能

微軟日前發布了用於 ORT 的生成式AI擴充,這是一個跨平台的AI推論函式庫。此一擴充為 Phi-3、Llama 3、Gemma 和 Mistral 等 LLM 加入支援量化等最佳化技術。ORT 利用包括 DirectML 在內的各種軟體和硬體堆疊,支援不同的推論 Execution Provider。

帶有 DirectML 後端的 ORT提供 Windows AI 開發者快速開發AI功能的方式,由此為廣泛的 Windows PC 生態系統提供穩定性和生產級支援。在 R555 Game Ready、Studio 和 NVIDIA RTX Enterprise 驅動程式中,已經能使用到 NVIDIA 針對適用於 ORT 的生成式AI擴充所提出的最佳化,幫助開發者在 RTX 上獲得比舊版驅動程式快上三倍的效能。

開發者可以利用新的 R555 驅動程式,釋放 RTX 硬體全部功能的潛力,更快為消費者帶來更快、更好的AI體驗。其中包括:

- 支援 DQ-GEMM metacommand以協助LLM 處理 INT4 僅權重值量化

- 針對 Llama 2、Llama 3、Mistral 和 Phi-3 模型提出全新 RMSNorm 標準化方法

- 分組與多查詢注意力(multi-query attention)機制,以及支援 Mistral 的滑動窗口注意力(sliding window attention)

- In-place KV 更新以提高注意力的效能

- 支援 non-multiple-of-8 tensor 的 GEMM,以提高語境階段效能

除上述外,NVIDIA 將 WebNN 中的AI工作流程調整至最佳狀態,以便在瀏覽器中直接提供 RTX GPU 的強大效能。WebNN 標準可協助網路應用程式開發者利用 Tensor 核心等裝置上的AI加速器,加快深度學習模型的執行速度。

WebNN 現已推出開發者預覽版,它使用 DirectML 和 ORT Web,即一個用於瀏覽器內模型執行的 Javascript 函式庫,讓人們更容易在跨平台的環境裡使用AI應用程式。這項加速技術使得 Stable Diffusion、SD Turbo 和 Whisper 等熱門模型在 WebNN 上的運行速度,比 WebGPU 快上四倍,現在已開放開發者使用。