NVIDIA 與 OpenAI 合作,針對 NVIDIA GPU 最佳化公司的全新開源 gpt-oss 模型,從雲端到 PC 提供聰明且快速的推論。這些全新推理模型支援代理型 AI 應用程式,例如網頁搜尋、深入研究等。

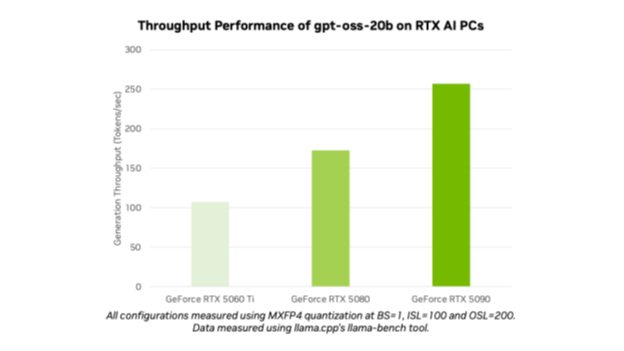

隨著 gpt-oss-20b 與 gpt-oss-120b 的發佈,OpenAI 已將這些頂尖模型開放給數百萬名使用者。AI 愛好者與開發者可透過 Ollama、llama.cpp 與 Microsoft AI Foundry Local 等熱門工具與架構,在 NVIDIA RTX AI PC 與工作站上使用最佳化模型,並在 NVIDIA GeForce RTX 5090 GPU 上取得每秒最多 256 個詞元(Token)的效能。

NVIDIA 創辦人兼執行長黃仁勳表示:「OpenAI 向世人展示了使用 NVIDIA AI 技術建構模型的深厚潛力,如今他們更進一步推動開源軟體的創新。」「gpt-oss 模型讓全球開發者都能使用這項尖端的開源基礎進行創建,鞏固美國在 AI 領域的科技領先地位 – 這一切皆建構於全球規模最大的 AI 運算基礎架構之上。」

這些模型的發佈凸顯了 NVIDIA 擁有的 AI 領導地位,包含訓練到推論,以及雲端到 AI PC 等領域。

所有人都能使用

gpt-oss-20b 與 gpt-oss-120b 都是靈活的開放權重推理模型,採用熱門的混合專家架構,提供思維鏈功能與可調整的推理工作量。這些模型的設計目的在於支援指令遵循和工具使用等功能,並在 NVIDIA H100 GPU 上訓練。AI 開發者可透過 NVIDIA Technical Blog 深入瞭解、取得說明並開始使用。

這些模型最多可支援高達 131,072 的上下文長度,是本地推論中最長的可用長度之一。這表示模型可透過上下文問題進行推理,非常適合網頁搜尋、編碼協助、文件理解和深入研究等工作。

OpenAI 開放式模型是 NVIDIA RTX 支援的第一款 MXFP4 模型。MXFP4 可提供高品質模型,展現快速效能,且相較於其他精準度類型,MXFP4 所需的資源更少。

使用 Ollama 在 NVIDIA RTX 上執行 OpenAI 模型

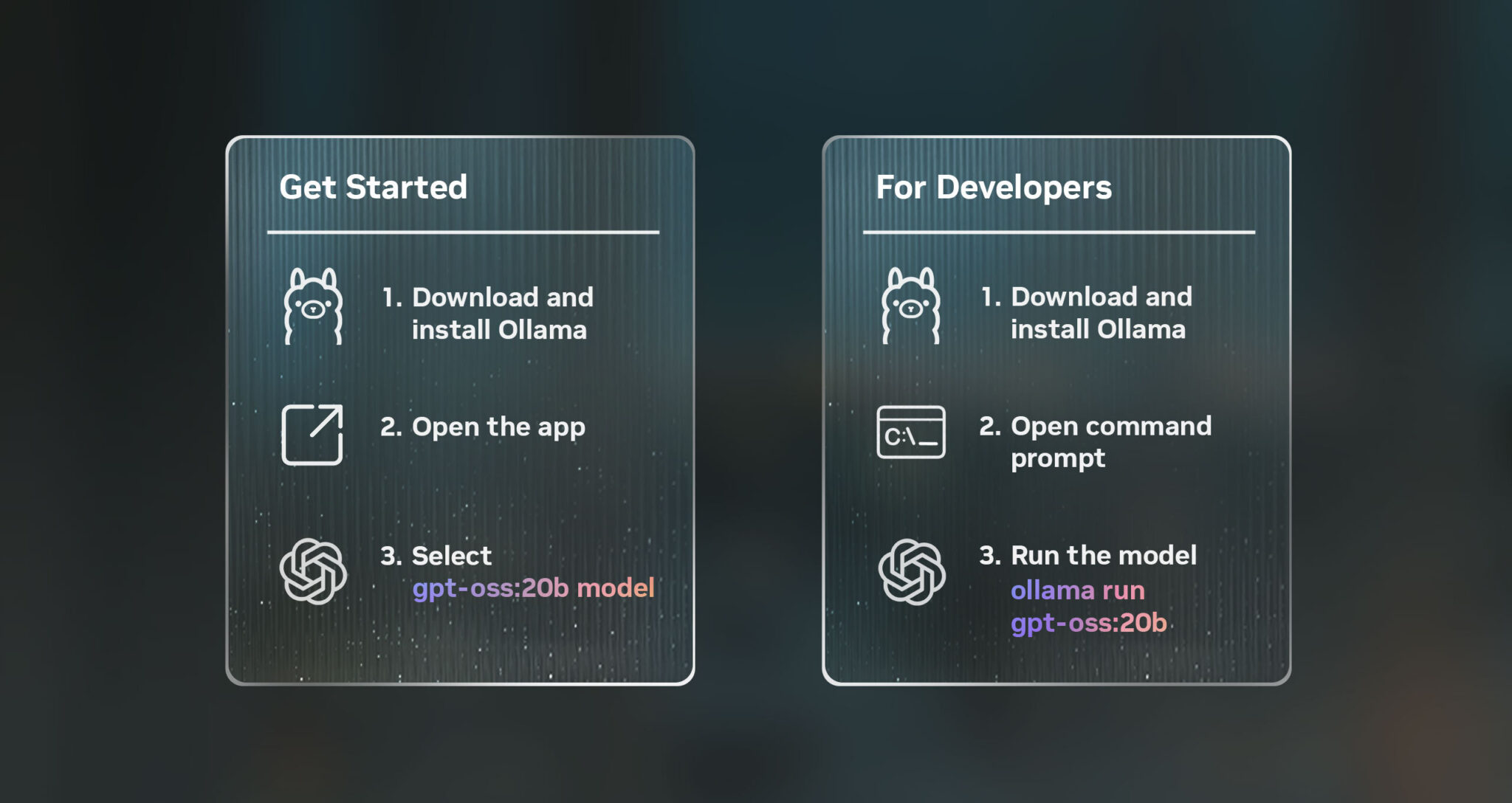

若要在配備至少 24 GB VRAM GPU 的 RTX AI PC 上測試這些模型,最簡單的方法就是使用全新的 Ollama 應用程式。易於整合的特色,以及針對 OpenAI 開放權重模型提供現成可用支援的全新使用者介面 (UI),讓 Ollama 在 AI 愛好者和開發者中受到歡迎。Ollama 針對 RTX 進行全面最佳化,對於希望在 PC 或工作站上體驗個人 AI 強大功能的消費者來說,會是理想選擇。

完成安裝 Ollama 後,即可快速且輕鬆地與模型進行交流。只需從下拉式功能表中選取模型並傳送訊息。Ollama 針對 RTX 進行了最佳化,因此無需額外設定或指令,即可確保支援的 GPU 達到最佳效能。

Ollama 的新應用程式包含其他新功能,例如在聊天中輕鬆傳送 PDF 或文字檔案、支援適用模型的多型態功能,讓使用者能在提示中加入影像,並在處理大型文件或聊天時輕鬆自訂上下文長度。

開發者也可透過命令列介面或應用程式的軟體開發套件 (SDK) 使用 Ollama,提升應用程式和工作流程。

在 RTX 上使用全新 OpenAI 模型的其他方式

AI 愛好者與開發者也可以在配備至少 16GB VRAM GPU 的 RTX AI PC 上透過其他應用程式和架構試用 gpt-oss 模型,一切皆由 RTX 提供支援。

NVIDIA 會持續與 llama.cpp 和 GGML tensor 程式庫的開放原始碼社群合作,進一步最佳化 RTX GPU 的效能。近期的貢獻包括實作 CUDA Graphs 以降低額外負荷,以及新增可降低 CPU 額外負荷的演算法。查看 llama.cpp GitHub repository 並開始使用。

Windows 開發者也可透過 Microsoft AI Foundry Local (目前公開預覽階段) 使用 OpenAI 的新模型。Foundry Local 是一種裝置端 AI 推論解決方案,可透過命令列、SDK 或應用程式介面整合至工作流程。Foundry Local 使用 ONNX Runtime,透過 CUDA 進行最佳化,並將支援 NVIDIA TensorRT for RTX。開始使用非常簡單:安裝 Foundry Local,並在終端機中執行指令「Foundry model run gpt-oss-20b」。

這些開放原始碼模型的發佈,開啟了下一波 AI 創新浪潮,讓開發者和愛好者能夠在 AI 加速的 Windows 應用程式中加入推理功能。

RTX AI Garage 部落格系列每週都會發表社群推動的 AI 創新成果和內容,讓有興趣的人深入瞭解 NVIDIA NIM 微服務和 AI Blueprint,以及在 AI PC 和工作站上建置 AI 代理、創意工作流程、生產力應用程式等內容。

在 Facebook、Instagram、TikTok 和 X 上關注 NVIDIA AI PC,並訂閱 RTX AI PC 電子報,隨時掌握最新消息。加入 NVIDIA Discord 伺服器,與社群開發者和 AI 愛好者交流,討論 RTX AI 的潛力。

在 LinkedIn 和 X 上關注 NVIDIA 工作站。

請參閱更多軟體產品資訊通知。