從數位人到寫作助手、智慧代理與創意工具,生成式 AI 正在將 PC 軟體轉變為突破性體驗。

NVIDIA RTX AI PC 和正在驅動這一項變革,相關技術讓用戶更輕鬆地探索生成式 AI,並在Windows 11 上釋放更強效能。

NVIDIA TensorRT 針對 RTX AI PC 全面革新,不僅保留業界領先的效能表現,更導入即時編譯的本地引擎建構技術,封裝體積大幅縮小至原來的八分之一,讓 AI 應用能更輕量、快速地部署至超過 1 億台 RTX AI PC。

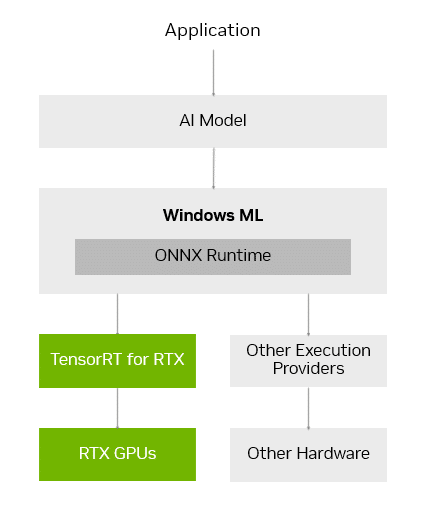

Microsoft Build 微軟開發者大會上公布,TensorRT for RTX 得到 Windows ML 的原生支持。這一全新推理框架為應用開發者提供廣泛的硬體相容性與業界領先的效能表現。

NVIDIA 發布的 SDK 讓為開發者帶來了廣泛的選澤,從 NVIDIA DLSS 到如 NVIDIA RTX Video 等多媒體增強功能,使開發者更輕鬆地整合 AI 功能。本月來自 Autodesk、Blibli、Chaos、LM Studio 和 Topaz Labs 的多款主流軟體應用將發布更新,解鎖 RTX AI 功能與加速效果。

AI 愛好者與開發者可通過 NVIDIA NIM 輕鬆上手AI開發。這是一套預先包裝且最佳化的 AI 模型,能夠在 AnythingLLM、Microsoft VS Code 和 ComfyUI 等主流應用程式中運行。本週推出的FLUX.1-schnell 圖像生成模型將會成為一項NIM微服務,而熱門的 FLUX.1-dev NIM 也已更新,並支援更多 RTX GPU。

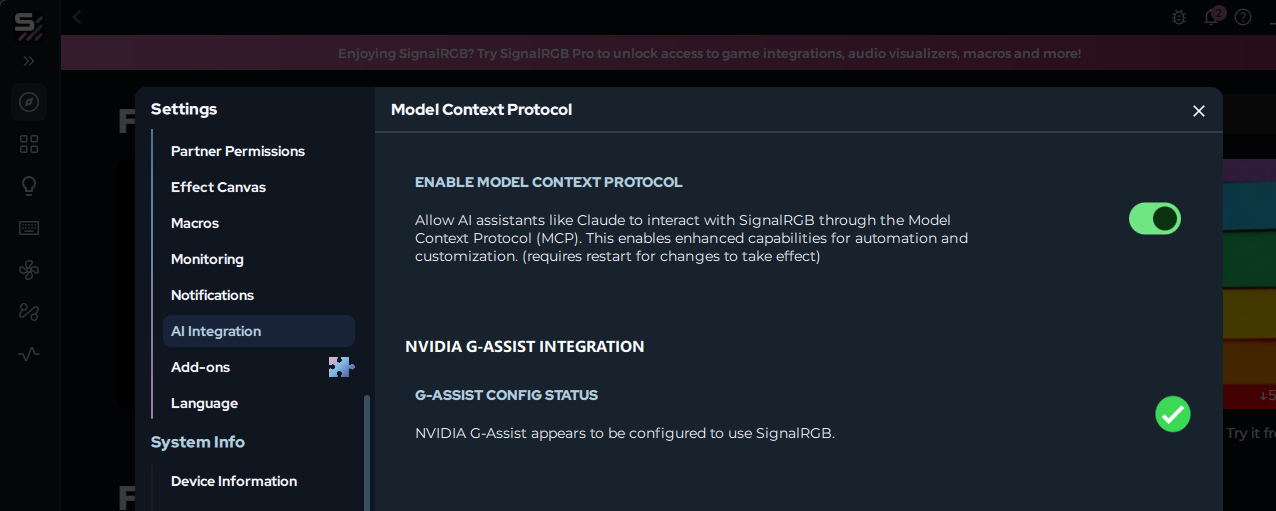

對於希望以簡單、零程式碼入門AI開發的用戶,Project G-Assist 是NVIDIA App 中的 RTX PC AI 助理,可以使用自然語言 AI 建置外掛程式來控制PC應用程式和周邊。目前已有多個全新的社群共享外掛程式,包括 Google Gemini 網頁搜索、Spotify、Twitch、IFTTT 和 SignalRGB 等。

TensorRT for RTX 為 AI 推論加速

當今的 AI PC 軟體堆疊要求開發者做出取捨——選擇硬體支援廣泛但效能較低的框架,或最佳化效能但只支援特定硬體。

全新的 Windows ML 推理框架為解決這些難題設計。Windows ML 是透過 ONNX Runtime 驅動,可無縫連接由各硬體廠商提供和維護的最佳化 AI 執行層。

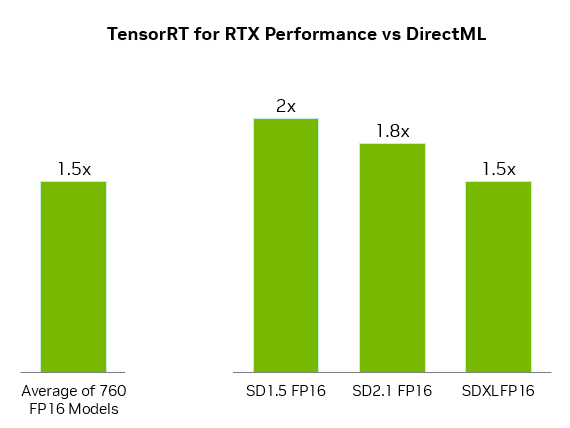

在 GeForce RTX GPU 上,Windows ML 會自動調用 TensorRT for RTX。這是一款專為高效能和快速部署推論庫。與 DirectML 相比,TensorRT在 PC 端 AI 工作負載中可帶來超過50%的效能提升。

Windows ML 在使用便利性上的優勢讓開發者受益匪淺。它可自動選擇合適的硬體,如 GPU、CPU 或 NPU 上,運行各項 AI 功能,並下載對應的執行程序,無需將相關文件封裝進應用程式中。這可以讓最新的 TensorRT 效能最佳化在完成時即可提供給使用者。

為進一步提升開發者體驗,TensorRT 已針對 RTX 平台進行了重新設計。開發者無需再預先生成TensorRT 引擎並隨應用封裝發布,TensorRT for RTX 採用即時執行的本地引擎建置模式,在數秒內針對使用者的 RTX GPU 進行 AI 模型運行最佳化。而此推論庫的封裝也進一步精簡,體積縮小了整整 8 倍。

TensorRT for RTX 現已通過 Windows ML preview 向開發者開放,並將在 六 月作為獨立 SDK 通過NVIDIA Developer 正式發佈。

開發者可在TensorRT for RTX發布部落格文章以及微軟的Windows ML 官方部落格文章,了解更多資訊。

擴展Windows 11 PC 上的 AI 生態系統

開發者若希望為應用程式增加 AI 功能或提升效能,可利用 NVIDIA 豐富的 SDK 工具組。這些包括用於 GPU 加速的 CUDA 與 TensorRT,用於 3D 繪圖的 NVIDA DLSS 與 OptiX,用於多媒體處理的 RTX Video 與 Maxine,以及用於生成式 AI 的 Riva、Nemotron 與 ACE。

本月,多款熱門應用程式發布更新,借助 NVIDIA SDK 實現專屬功能:

- LM Studio 已發布更新,升級至最新 CUDA 版本,效能提升超 30%。

- Topaz 將推出一款透過 CUDA 加速,用於提升影片畫質的生成式 AI 影片模型。

- Chaos Enscape與Autodesk VRED將加入DLSS 4支援,實現更高效能與更好的影像品質。

- BiliBili將整合多項NVIDIA Broadcast功能,包括 NVIDIA虛擬背景等,從而提升直播品質。

NVIDIA 期待持續與微軟及領先AI應用開發者合作,通過 Windows ML 與 TensorRT 的整合,幫助他們在 RTX 驅動的設備上加速他們的 AI 功能。

NIM 微服務與 AI Blueprint 讓本地 AI 開發更輕鬆

AI 開發起步對於 PC 用戶來說往往十分繁瑣。AI 開發者和愛好者需要從 Hugging Face 上超過120 萬個模型中篩選合適模型,將其量化為適合自己 PC 運行的格式,配置並安裝各種相依套件,步驟繁多。

NVIDIA NIM 讓這一切變得簡單:它提供精心挑選的 AI 模型,預先封裝所需全部文件,並經過最佳化,可在 RTX GPU 上以最高效能運行。作為容器化微服務,NIM 可在 PC 與雲端之間無縫運行。

NVIDIA NIM 微服務可通過build.nvidia.com 或主流 AI 應用,如 Anything LLM、ComfyUI 和適用於 Visual Studio Code 的 AI Toolkit 下載。

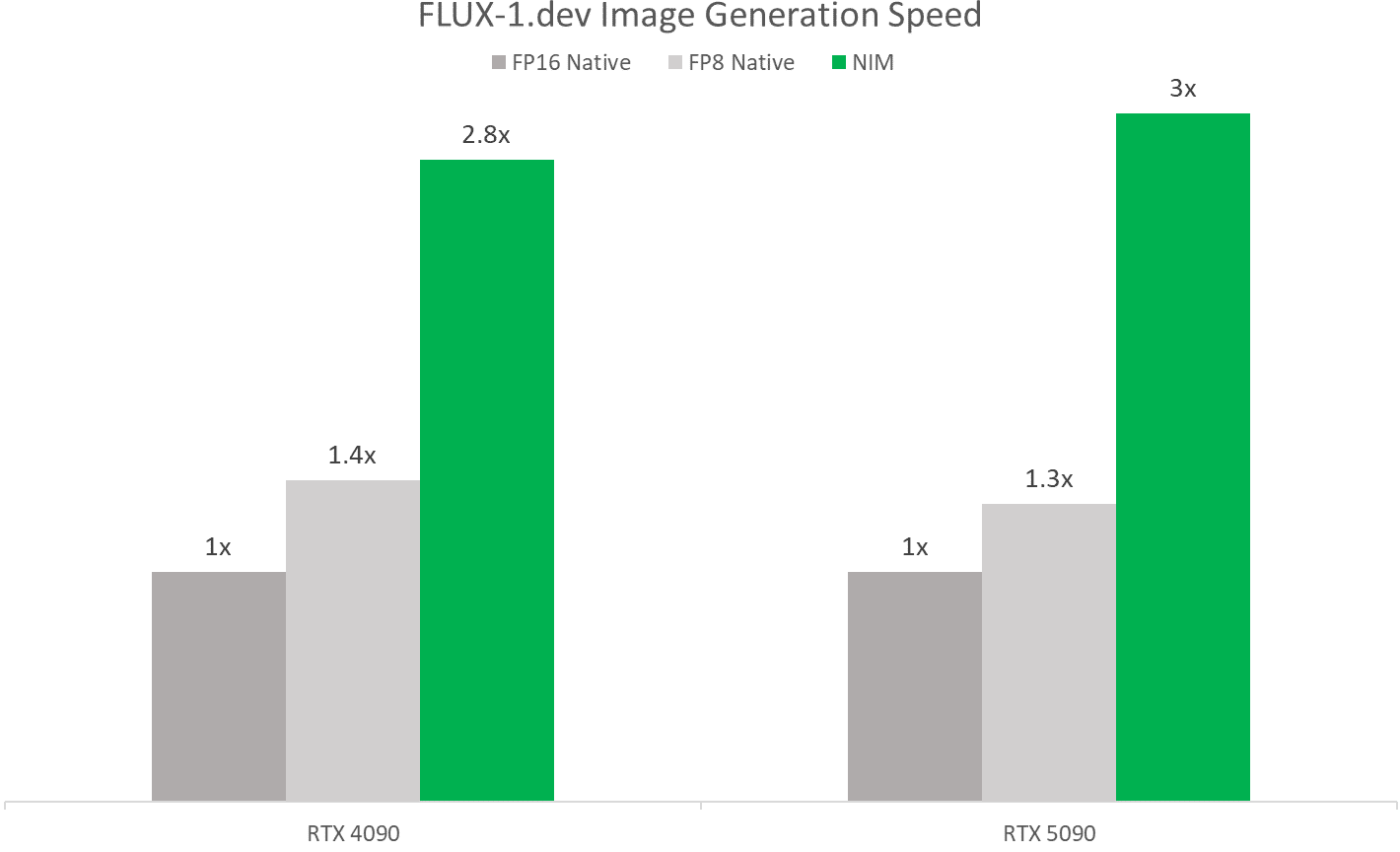

在 COMPUTEX 大會上,NVIDIA 將發佈 FLUX.1-schnell NIM —— 由 Black Forest Labs 打造的高速圖像生成模型,並更新 FLUX.1-dev NIM,拓展其對廣泛的 GeForce RTX 50 與 40 系列 GPU 的相容性。

這些 NIM 通過 TensorRT 實現更高效能,量化模型也得到進一步加速。在 Blackwell GPU 上,得益於 FP4 與 RTX 最佳化,其運行速度是原生模型的兩倍以上。

AI 開發者還可以通過 NVIDIA AI Blueprint——基於 NIM 微服務的示範工作流程與計畫框架快速啓動項目。

上個月,NVIDIA 發布了 3D 引導生成式 AI Blueprint,該方案可通過 3D 場景作為參考,精準控制生成圖像的構圖與視角。開發者可根據自身需求修改此一開源 Blueprint,或擴展其功能。

全新 Project G-Assist 外掛程式與示範計畫現已上線

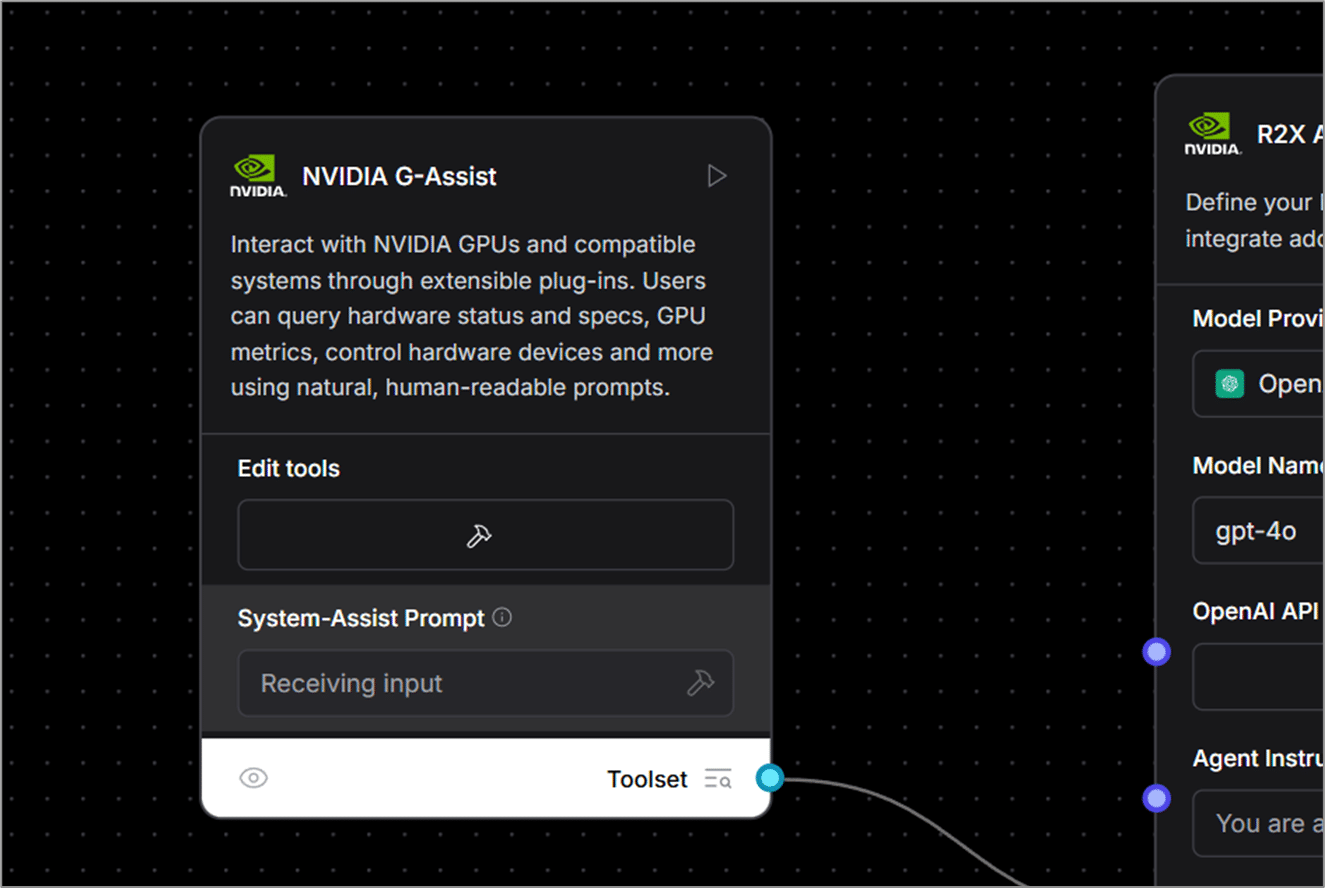

NVIDIA 近期推出了Project G-Assist,一個實驗性的 AI 助理功能。G-Assist 讓使用者可通過簡單的語音或文本指令控制GeForce RTX系統,相較於傳統多個控制面板的手動操作界面,更加便捷直觀。

開發者可利用 Project G-Assist 輕鬆建置外掛程式、測試助理使用案例,並通過 NVIDIA 在Discord與 GitHub 的官方帳號上發佈。

為方便使用者上手開發外掛程式,NVIDIA 現已提供簡便易用的外掛程式建置工具(Plug-in Builder)——一個基於 ChatGPT 的應用程式,支援零程式碼或低程式碼開發,僅通過自然語言指令即可生成外掛程式。這些輕量化、社群驅動的附加程式,採用簡單的JSON 結構與 Python邏輯編寫。

多款全新開源外掛程式範例現已上線 GitHub,展示本地 AI 如何增強 PC 與遊戲工作流程:

- Gemini:現有Gemini 外掛程式已更新,新增對 Google 免費雲端 LLM 的即時網頁搜索功能。

- IFTTT:支援接入數百個 IFTTT 端點,驅動 IoT 慣例,例如調整房間燈光或智慧窗簾、或將最新遊戲新聞推送至行動裝置等。

- Discord:玩家在不中斷遊戲的情況下,可輕易分享遊戲精彩時刻或訊息至 Discord 服務器。

前往 GitHub 探索更多範例,包括通過 Spotify 實現免手操作音樂控制、使用 Twitch 進行直播狀態檢查等。

越來越多廠商也開始採用AI 作為新的 PC 介面。例如,SignalRGB 正開發 G-Assist 外掛程式,實現多品牌設備間的統一燈效控制。SignalRGB 使用者不久後將可直接通過 SignalRGB APP 安裝此外掛程式。

從本週起,AI 開發者社群將能夠在 Langflow 中以自定義組件形式使用 G-Assist 外掛程式——從而讓使用者能夠在低程式碼或零程式碼工作流程、AI 應用及智能體流程中整合函式呼叫(function-calling)功能。

歡迎對 Project G-Assist 外掛程式開發與實驗感興趣的愛好者加入 NVIDIA Developer Discord 頻道,參與合作、分享作品,並獲得支援。

每周,RTX AI Garage部落格系列都會分享由社群推動的 AI 創新與內容,面向希望深入瞭解 NIM微服務、AI Blueprint,以及如何在 AI PC 和工作站上建置 AI 代理、創意工作流程、數位人、生產力應用程式等的使用者。

歡迎在 Facebook、Instagram、TikTok 和 X 關注NVIDIA AI PC,並訂閱 RTX AI PC 電子報。