編者按:此篇文章屬於「解碼 AI 」系列,該系列文章會以簡單易懂的方式解碼 AI,同時展示適用於 RTX PC 和工作站使用者的全新硬體、軟體、工具和加速功能。

如果說 AI 的 iPhone 時刻已經到來,那麼聊天機器人便會是率先流行起來的應用程式。

聊天機器人能夠問世,要歸功於大型語言模型,這種深度學習演算法以像網路本身一樣龐大的大量資料集預先訓練,可以辨識、總結、翻譯、預測並產生文字和其他形式的內容。這些模型都可以在採用 NVIDIA GeForce 和 RTX GPU 的 PC 和工作站上本機執行。

LLM 擅長為大量文字做總結、分類和挖掘資料以取得見解,以及以使用者指定的風格、語氣或格式產生新文字。這些模型可以促進各種語言的溝通,甚至不限於人類所用的語言,例如電腦程式碼或蛋白質和基因序列。

早期的 LLM 只能處理文字,但後來的版本則是使用其他類型的資料進行訓練。這些多型態 LLM 可以辨識與產生影像、音訊、影片和其他形式的內容。

ChatGPT 等聊天機器人是最早讓消費者受眾有機會接觸 LLM 的應用方式,其熟悉的介面專為交談以及對自然語言提示做出回應而設計。此後,LLM 便用來協助開發人員編寫程式碼,以及協助科學家加速藥物探索和疫苗開發。

LLM 的一個例子是 Google 的 Gemma,您可以在 NVIDIA 的 AI Playground 中體驗技術展示。

但支援這些功能的 AI 模型需要密集的運算能力。將量化等進階最佳化技術和演算法與專為 AI 打造的 RTX GPU 相結合,有助於讓 LLM 夠精簡並讓 PC 效能夠強大,足以在本機執行而不需要網際網路連線。而 Mistral 這類新一代輕量型 LLM 是支援 Chat with RTX 的其中一種 LLM,為滿足低耗能和儲存空間需求的頂尖效能奠定基礎。

LLM 為何重要?

LLM 適用於多種使用案例、產業和工作流程。這樣的多功能性結合高速效能,能為幾乎所有以語言為主的工作提升效能和效率。

LLM 廣泛用於 DeepL 等語言翻譯應用程式,而 DeepL 會使用 AI 和機器學習輸出準確的內容。

醫學研究人員運用教科書和其他醫療資料訓練 LLM,提升病患照護的品質。零售商利用採用 LLM 技術的聊天機器人,提供出色的客戶支援體驗。金融分析師利用 LLM 將法說會和其他重要會議內容轉譯和總結。而這些應用方式都只是冰山一角。

像 Chat with RTX 的聊天機器人以及以 LLM 為基礎的寫作助理,影響遍及各個層面的知識工作,從內容行銷、文案撰寫到法律業務都包含在內。編寫程式助理是率先採用 LLM 技術的應用程式之一,由此可見 AI 輔助軟體開發的未來。現在,ChatDev 這類專案會將 LLM 與 AI 代理系統結合,這些智慧機器人能自主協助回答問題或執行數位工作,因此可依照需求組成虛擬軟體公司。只要告訴系統需要什麼樣的應用程式,系統就會開始作業。

在 NVIDIA 開發人員部落格上深入瞭解 LLM 代理系統。

像展開對話一樣簡單

許多人第一次接觸生成式 AI 的經驗都是使用像 ChatGPT 的聊天機器人,這類聊天機器人透過自然語言簡化 LLM 的使用方式,因此使用者需要採取的行動變得十分簡單,只要直接告訴模型該做什麼即可。

使用者可以在 NVIDIA 的 AI Playground 中與 Meta 的 Llama 2 這類 LLM 互動。

採用 LLM 技術的聊天機器人可以協助撰寫行銷文案草稿、提供度假建議、撰寫聯絡客服的電子郵件,甚至可以創作原創詩詞。

影像產生和多型態 LLM 領域的進展將聊天機器人的用途擴展至分析和產生影像,同時又能維持極其簡便的使用者體驗。只要向機器人描述影像或上傳相片,再要求系統分析即可。互動仍然是聊天的形式,但現在多了視覺輔助。

若要深入瞭解這些機器人的設計原理,請觀看使用 RAG 打造智慧 AI 聊天機器人的隨選線上研討會。

未來的進展會有助於 LLM 發展邏輯、推理、數學等能力,進而有能力將複雜的要求細分為較小的子工作。

在 AI 代理系統方面也有所進展,這類應用程式能夠將複雜的提示細分為較小的提示,並與 LLM 和其他 AI 系統自主互動以完成這些提示。ChatDev 是 AI 代理系統框架的一個例子,但代理系統的用途不限於技術工作。

舉例來說,使用者可以要求個人 AI 旅行代理系統為全家預訂出國度假行程。代理系統會將任務細分為子工作 (包括行程規劃、預訂交通票券和住宿、建立打包清單、尋找協助遛狗的人) 並依序個別執行。

運用 RAG 發揮個人資料的價值

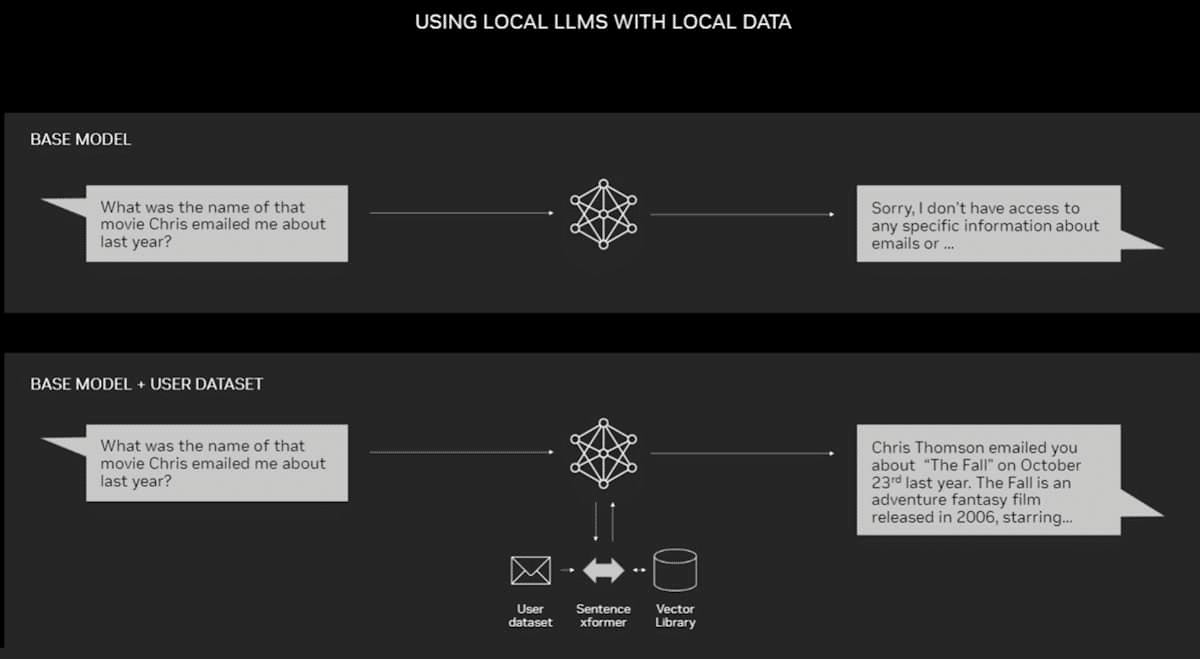

儘管 LLM 和聊天機器人在一般用途就能發揮強大的功能,但若能與個別使用者的資料結合使用,便可以發揮更大效用。結合個人資料後, LLM 和聊天機器人可以協助分析收件匣中的電子郵件以找出趨勢、爬梳密密麻麻的使用者手冊以解答某些硬體技術問題,或者將多年的銀行和信用卡對帳單總結。

檢索增強生成 (簡稱 RAG) 是針對特定資料集精進 LLM 最簡單有效的方法之一。

RAG 利用從外部來源取得的事實,提升生成式 AI 模型的準確度和可靠性。RAG 可將 LLM 與幾乎任何外部資源連結,讓使用者能夠與資料儲存庫交談,同時也讓 LLM 能夠引用其來源。使用者體驗非常簡單,只需向聊天機器人指定檔案或目錄即可。

舉例來說,標準 LLM 可以掌握內容策略最佳做法、行銷策略,以及對特定產業或客群基本見解的一般知識。但透過 RAG 將標準 LLM 與輔助產品發佈的行銷資產連結之後,便能分析內容並協助規劃量身打造的策略。

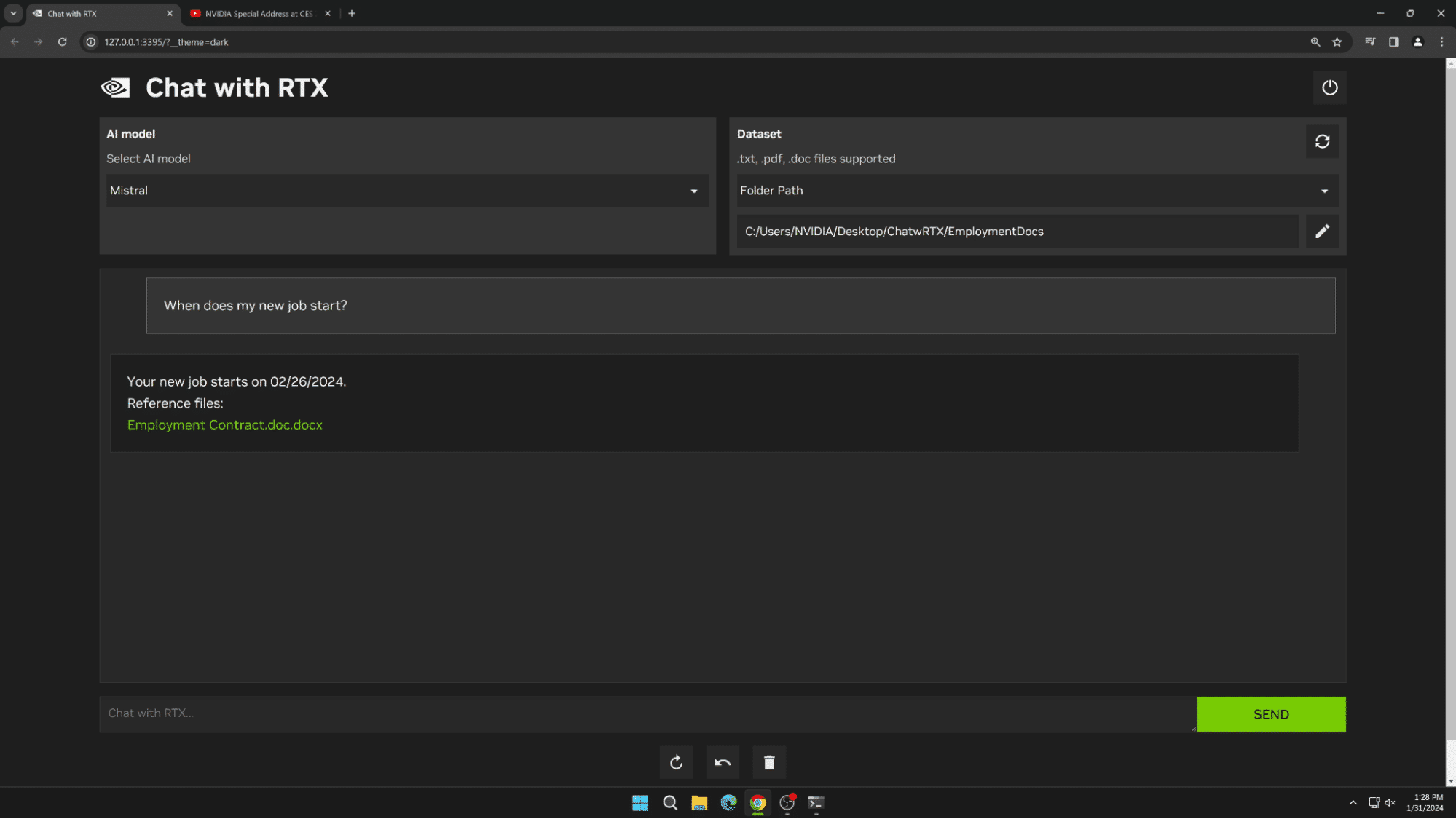

在應用程式的支援下,RAG 能與任何 LLM 搭配使用。NVIDIA 的 Chat with RTX 技術展示就是 RAG 將 LLM 連結到個人資料集的範例。此應用程式可在配備 GeForce RTX 或 NVIDIA RTX 專業級 GPU 的系統上本機執行。

若要深入瞭解 RAG 以及其與微調 LLM 的比較結果,請參閱技術部落格 RAG 101:檢索增強生成解答。

體驗 Chat with RTX 的速度與隱私保護

Chat with RTX 是易於使用且可免費下載的本機個人化聊天機器人展示品。這款聊天機器人具備 RAG 功能以及 TensorRT-LLM 和 RTX 加速功能。Chat with RTX 支援多種開放原始碼 LLM,包括 Meta 的 Llama 2 和 Mistral 的 Mistral。未來的更新將提供對 Google Gemma 的支援。

使用者只要將檔案放入資料夾,並向機器人指出該位置,即可輕鬆將 PC 上的本機檔案連結至支援的 LLM。如此一來,機器人就能快速回答出符合情境的答案。

由於 Chat with RTX 透過 GeForce RTX PC 和 NVIDIA RTX 工作站在 Windows 本機上執行,隨即就能產生結果,而且使用者的資料會保留在裝置。Chat with RTX 不需仰賴雲端服務,而是讓使用者在本機 PC 上處理敏感資料,無需與第三方共用資料或連接至網際網路。

若要深入瞭解 AI 如何形塑未來,請關注全球 AI 開發人員大會 NVIDIA GTC,活動將於 3 月 18 日至 21 日於加州聖荷西舉辦,也歡迎線上參與。