在反映部分高難度推論情境的最新 MLPerf Inference V5.0 基準測試中,NVIDIA Blackwell 平台創下多項紀錄,這也是 NVIDIA 首次使用專為人工智慧(AI)推理作業設計的機架規模解決方案 NVIDIA GB200 NVL72 系統來提交 MLPerf 測試報告。

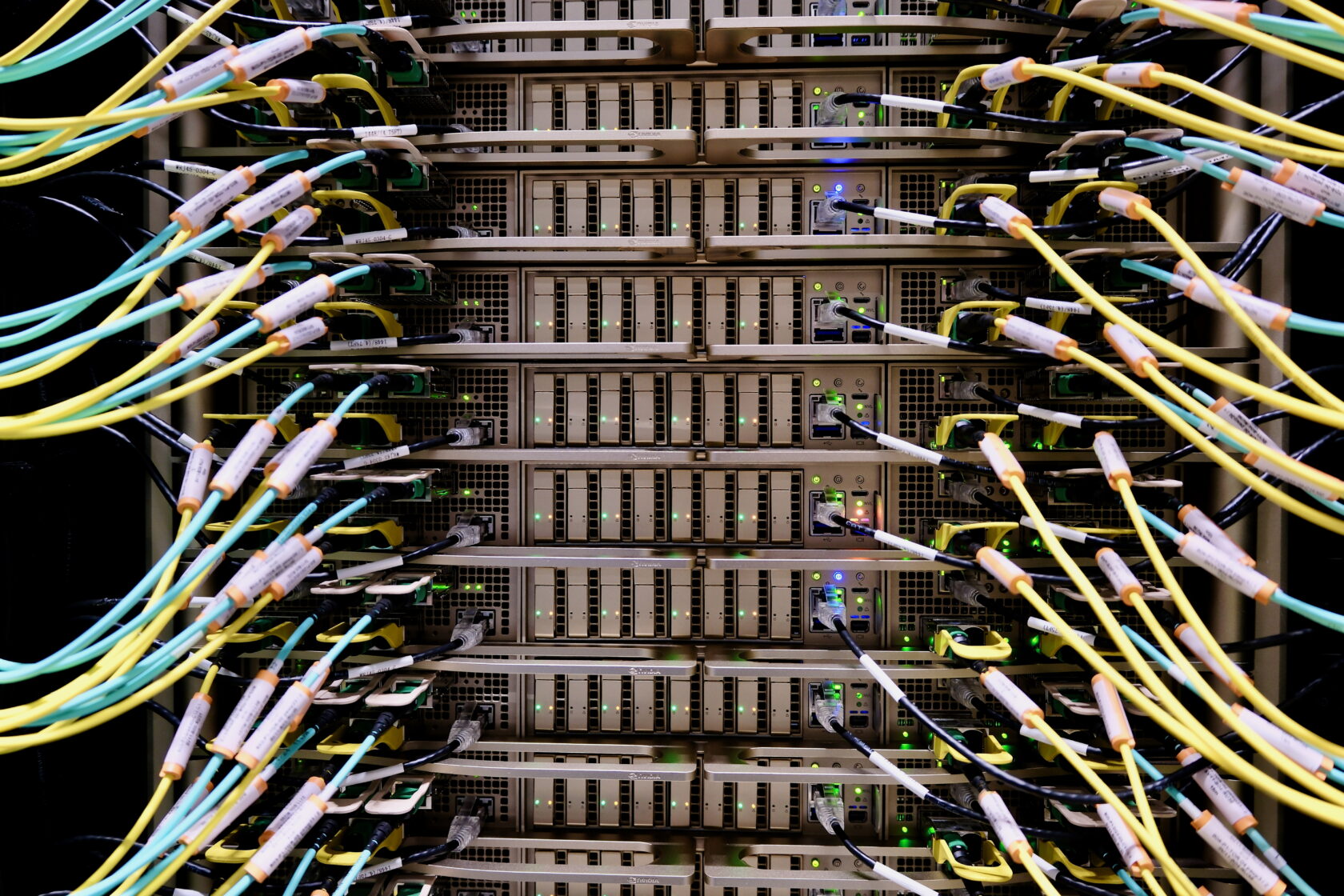

為落實打造尖端 AI 的承諾,需要稱為 AI 工廠的新型運算基礎設施。與傳統的資料中心不一樣,AI 工廠不只是用於儲存與處理資料,而是透過將原始資料轉換為即時洞察,來大規模製造智慧。AI 工廠的目標很簡單:用最低成本,盡量為最多的使用者快速提供準確的查詢答案。

要做到這個目標的複雜性相當高,並且是在幕後進行。隨著 AI模型加大到有著數十億甚至數兆個參數,以提供更聰明的回覆內容,產生每個詞元(token)所需的運算量也隨之增加。這項需求會減少 AI 工廠可產生的詞元數量,並且提高每個詞元的成本。如果想要保持高推論輸送量和低單位詞元成本,就必須在晶片、網路系統和軟體等技術堆疊的每一層快速進行創新。

經同業審查的推論效能業界基準 MLPerf Inference,其最新更新項目包括加入 Llama 3.1 405B,這是規模最大且最難運行的開放權重模型之一。與原本的 Llama 2 70B 基準相比,新的 Llama 2 70B Interactive 基準有著更嚴格的延遲要求,更能反映生產部署環境在提供最佳使用者體驗方面的限制。

除了 Blackwell 平台之外,在全端最佳化的助力下,NVIDIA Hopper 平台也全面展現出優異效能,在 Llama 2 70B 上的效能較去年顯著提升。

NVIDIA Blackwell 寫下新紀錄

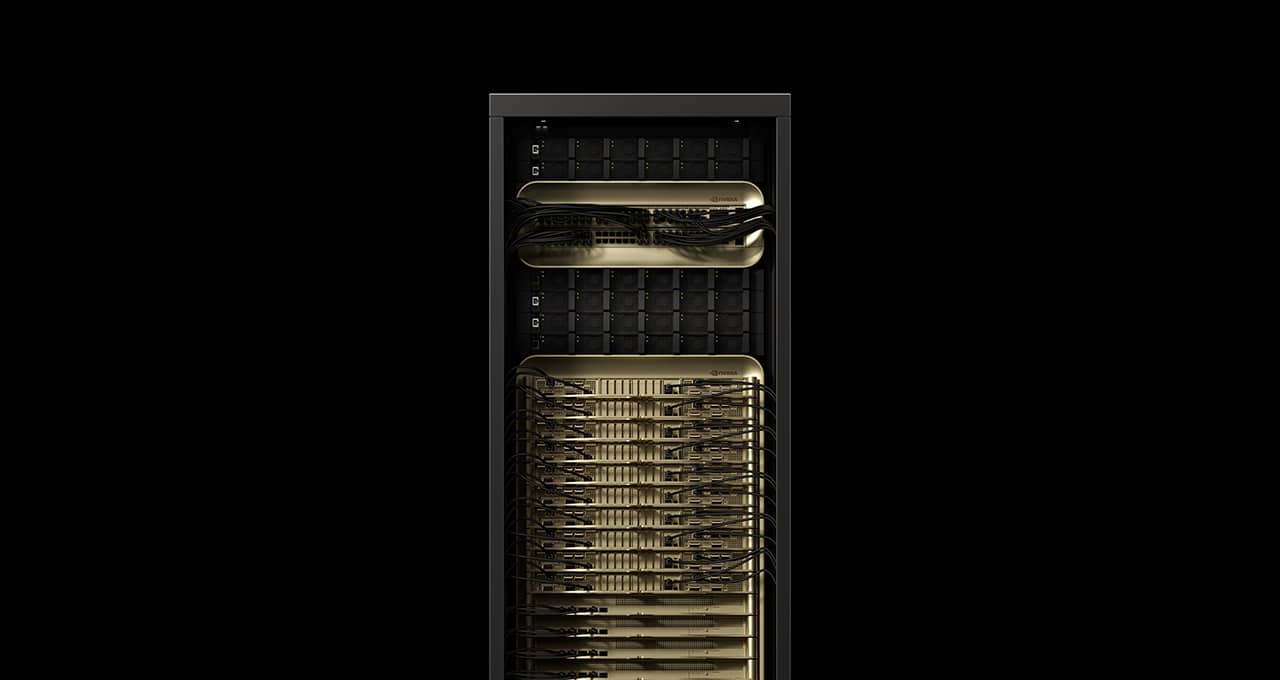

連接 72 顆 NVIDIA Blackwell GPU 作為單一大型 GPU 的 GB200 NVL72 系統,在 Llama 3.1 405B 基準測試中的輸送量,比本輪使用 NVIDIA H200 NVL8 提交的結果高出 30 倍。這項壯舉是透過每顆 GPU 提高三倍的效能,再加上高出九倍的 NVIDIA NVLink 互連網域助力下來達成。

雖然許多公司都在其硬體產品上進行 MLPerf 基準測試以評估效能,但只有 NVIDIA 及其合作夥伴提交並公開 Llama 3.1 405B 基準測試的結果。

生產推論部署環境通常在兩大關鍵指標上有延遲限制。首先是產生首個詞元的時間(TTFT),也就是使用者需要花多少時間才能開始看到大型語言模型對查詢的回應。再者是產生每個輸出詞元的時間(TPOT),也就是將詞元傳送給使用者的速度。

全新 Llama 2 70B Interactive 基準測試的 TPOT 縮短了五倍,TTFT 則降低了 4.4 倍,可以創造出反應更迅速的使用者體驗。NVIDIA 在本輪測試所提交的測試報告中,使用搭載 8 顆 Blackwell GPU 的 NVIDIA DGX B200 系統,其效能較搭載 8 顆 NVIDIA H200 GPU 的系統高出三倍,為這項更具挑戰性的 Llama 2 70B 基準樹立更高標準。

結合 Blackwell 架構及其經過最佳化的軟體堆疊,可以讓推論效能更上一層樓,為 AI 工廠打好基礎,以提供更高的智慧、更高的輸送量與更快的詞元生成率。

採用 NVIDIA Hopper 的 AI 工廠價值持續提升

NVIDIA Hopper 架構於 2022 年推出,驅動了現今許多 AI 推論工廠,也持續支援訓練各種模型。透過持續的軟體最佳化,NVIDIA 提升了採用 Hopper 架構 AI 工廠的輸送量,進而創造出更龐大的價值。

在一年前於 MLPerf Inference v4.0 首次推出的 Llama 2 70B 基準測試中,H100 GPU 的輸送量增加了 1.5 倍。H200 GPU 以相同的 Hopper GPU 架構為基礎,搭配更大、更快的 GPU 記憶體,又將輸送量加大到 1.6 倍。

Hopper 架構也執行了所有的基準測試,包括新加入的 Llama 3.1 405B、Llama 2 70B Interactive 及圖形神經網路測試。這種多樣性代表 Hopper 可以運行多種工作負載,並在模型和使用情境變得更具挑戰性時跟上腳步。

不可或缺的生態系

在本輪 MLPerf 測試中,共有 15 家合作夥伴提出使用 NVIDIA 平台進行測試的優秀成績,包括華碩、思科、CoreWeave、戴爾科技集團、富士通、技鋼科技(Giga Computing)、Google Cloud、慧與科技、Lambda、聯想集團、Oracle Cloud Infrastructure、雲達科技、美超微、Sustainable Metal Cloud 和 VMware。

從參賽作品的廣度可以看出 NVIDIA 平台的影響力,全球所有雲端服務供應商及伺服器製造商皆可使用 NVIDIA 平台。

MLCommons 致力於持續發展 MLPerf Inference 基準套件,以跟上 AI 領域的最新發展,並為生態系提供嚴謹且經同業審查的效能數據,這對協助 IT 決策者選擇最佳的 AI 基礎架構而言至關重要。

進一步瞭解 MLPerf。